Comprendre les limites de l’IA

Quand l’IA invente

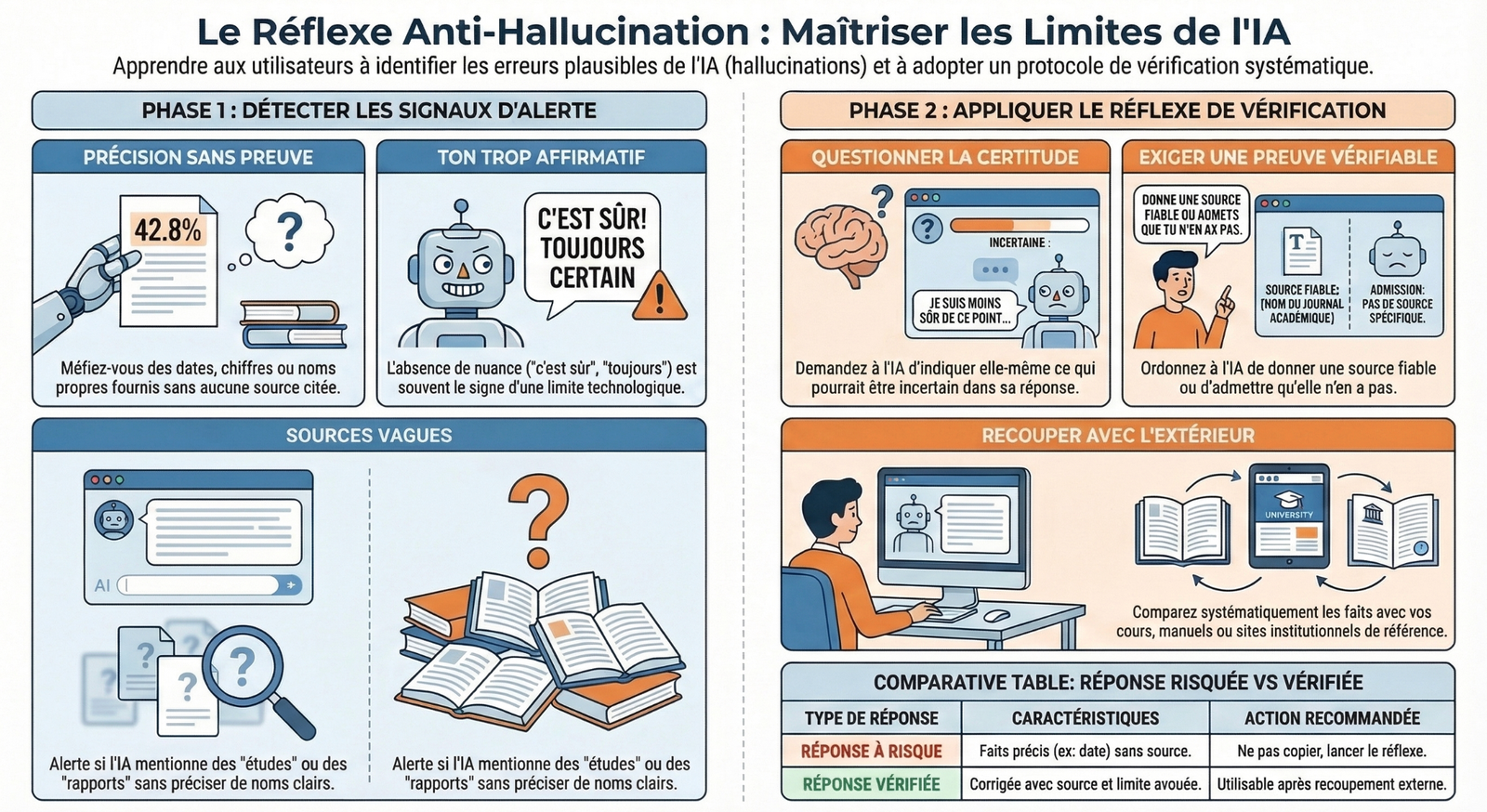

Parfois, une IA donne une information fausse avec un ton très sûr. Ce n’est pas forcément de la mauvaise volonté. C’est une limite de la technologie. Dans cette leçon, je développe un réflexe simple pour repérer et corriger ces erreurs.

Objectifs de la leçon

- Je comprends ce qu’on appelle une hallucination

- Je repère les signaux d’alerte dans une réponse

- Je sais relancer l’IA pour vérifier et corriger

- Je recoupe avec une source fiable quand c’est important

Idée clé

L’IA ne vérifie pas la vérité. Elle produit une réponse plausible.

Les signaux d’alerte

Détails très précis sans preuve

- dates exactes

- chiffres

- noms propres

- aucune source

Ton trop certain

- “c’est sûr”

- “toujours”

- “jamais”

- pas de nuance

Réponse qui change quand je relance

- une nouvelle date apparaît

- une nouvelle définition apparaît

- la première réponse était fragile

Sources vagues ou introuvables

- “selon des études”

- “un rapport dit que”

- mais aucun nom clair

Le réflexe en 3 étapes

Je demande à l’IA si elle est sûre et ce qui pourrait être faux.

Je demande une source ou une justification vérifiable.

Je compare avec une source externe (manuel, cours, site institutionnel).

Quand c’est important, je demande un contre-exemple.

Exemples concrets

Elle semble sûre

Je vérifie

Mini quiz

Choisis la meilleure option, puis clique sur “Vérifier mes réponses”.

1) Une hallucination, c’est

2) Le meilleur réflexe face à un fait précis

3) Un signal d’alerte

À faire maintenant

Je choisis une information “factuelle” (date, définition, formule, événement). Je demande une réponse à l’IA puis je colle ce prompt.